-

图像信息是人类实现对外界态势感知的重要参考依据。以光学成像技术为基础的图像信息获取技术在成像分辨率、目标识别能力、形貌与纹理分析、探测隐蔽性和视觉直观性方面具有明显优势。然而,当光透过强散射介质时,成像光场会受到严重的破坏,成像效果急剧恶化,光电探测系统的作用距离被大大压缩。例如:雾霾条件使得成像系统的作用距离被局限在能见度范围内;水下环境中存在大量的杂质,如泥沙、藻类以及各种有机物,在这些杂质的吸收和散射效应共同破坏下,水下光学成像装置的作用距离往往难以超过6-7个光学厚度。因此,如何突破散射现象的限制,实现远距离光学成像,是目前光学成像领域的一个重要的前沿问题。近年来,研究者在克服散射影响的成像恢复方面作了大量的研究,主要包括波前整形[1-2]、自适应光学技术[3]、光学选通技术[4]、散斑相关技术等[5]。这些突破性的研究成果也成为了解决强散射环境下成像的重要途径。

远距离光学成像受到的制约因素可以分为成像系统固有的和成像系统外在的限制。固有限制包括衍射极限、传感器像素大小和数量、透镜像差等。外在限制主要是由传播介质的非均匀性引起,以大气为例:湍流大气造成光束缓慢整体偏转,自适应光学是最佳的应对方案;混浊大气无规则快速运动造成光场完全混乱从而影响光学成像,目前尚无普适的解决方案[6]。同时,相机性能和计算能力也是制约远距离光学成像的因素。当相机量子效率越高、满阱越大、暗噪声越小、传感器速度越快,可以捕获到对比度和相关性更高的动态散斑。此外,在低能见度环境下,多帧图像融合相较于单帧图像采集,具备提高图像动态范围,优化去雾效果的能力。在人类视觉系统的辅助下,多视融合和双目观察的方法可能为远距离成像提供新的技术路线。

散射环境包括多种场景,例如浑浊水体、雾霾、烟雾、生物组织等。文中立足于强散射背景下的图像感知、融合与可视化链路,着重介绍了针对低能见度大气等常见大尺度散射场景中的成像问题与相关技术。

-

当光透过散射介质时,根据受到的散射程度不同,光子在散射介质中的传播可以分为弹道光子、蛇形光子和散射光子。其中,弹道光子几乎没有受到散射的作用,传播方向与入射光相同,传播路程最短,出射后保留了入射光子的大部分特征,而散射光子受到多重散射,传播路程较长,出射方向严重偏离了原来的入射状态,丢失了大部分入射光的初始特征,蛇形光子则介于两者之间。当散射较弱时,弹道光子和蛇形光子占据了图像传感器接收信号的主要成分,其表现为系统点扩散函数(PSF)的展宽。随着成像距离的增加,散射效应越来越强,当散射光子占据主导时,图像信息将难以解译,这就大大限制了光电系统的有效作用距离。

1976年,McCartney[7]基于计算机视觉与计算机图像理论提出了一种粗糙地描述大气散射的唯像模型,并由Narasimhan与Nayar等人[8-10]逐渐完善。该模型表示为:

式中:I为像面所收集到的退化图像的强度分布;(x,y)为二维平面坐标;t为大气透射率;O为受到散射之前的强度分布;A为大气干扰光项,即成像过程中光源照亮散射介质,被探测器所收集到的光。这样一种模型中目标被近似为了一种自发光的目标,而非被照亮的后反射。

然而在大气环境中,目标通常被环境光照亮,比如阳光。这意味着成像过程中被探测器所收集到的光由两部分组成,一部分是目标物体的反射,一部分是大气散射颗粒本身的反射和散射,图1(a)的光学模型很好地描述了这种成像过程。

Figure 1. (a) Schematic diagram of atmospheric optical imaging model; (b) Effect of foggy scenes on contrast

将气溶胶视为均匀的介质[11],光学模型可以表示为:

式中:等号右边第一项为直接衰减项;第二项为大气干扰光项。L∞为照明光,通常将其视为常数,即与位置(x,y)无关;ρ为场景中目标的反射率;β为大气衰减系数;d为目标与观测者之间的距离,可以发现e−βd(x,y)就是大气透射率t。

判断目标是否可见,需要将人的主观判断转换为依赖判据的客观判断。对比度就是一种衡量感知清晰程度的重要手段,它表征的是目标物体与图像中其余物体,也就是背景之间的相对强度差异。差异越大,对比越强,目标就越清晰。因此,人眼无法识别用白色颜料在白纸上写的字;墨水滴入墨水瓶中就再也找不到。如图1(b)所示,大气的散射会导致对比度的直接下降。根据大气光学成像模型[12],在大气散射条件下,光学图像的对比度随着光学厚度βd的增加成指数下降的趋势。令清晰无雾场景下目标的固有对比度C0为:

使用公式(1)中大气散射模型,在基线长度L、透射率为t的大气下,可以得到散射后目标强度Iobj,sca与散射后背景强度Ibg,sca:

此时,接收端目标在背景中的对比度CL为:

由公式(6)可以看出,透射率的降低或大气干扰光的增强,都会导致接收端目标对比度的降低。这也就意味着背景干扰与目标信号之间的差异因散射而弱化,所以探测器的信号分辨能力对强散射背景下的有效信息提取至关重要。

探测器对信号的分辨能力主要由动态范围与模数转换的位深共同决定。将一个像素视为盛水的桶,完全没有光子输入时会呈现黑电平状态,而像素中光电效应产生的电子如果存储太满就会溢出。当收集的电子刚好占满像素,新入射的光子就不能被分辨,此时,像素的电平达到最大值,这个电平也被称为白电平。这个最大电子数的限制也被称作满阱。在每次探测时电路中的各种噪音与残余电荷等各种因素都会使得输出的数值与真实情况有所偏差,这样的偏差就是读出噪音。动态范围描述了探测器在一次探测时最大和最小可测量光强度之间的比率,即对应着满阱电子数与读出噪音之比。

通常,位深比其动态范围更为充裕。所以,对于接收端的目标像素块与背景像素块,只有当其对比度大于动态范围所限制的最小精度时,目标才有可能从背景中被识别出来。

这也意味着在大气散射条件下,探测器从背景中分辨目标需要有以下关系:

式中:DR为探测器动态范围,如果不满足上式,那么微弱的强度差异就会受动态范围所限制,而不能够给出有效的输出数值差异。上式取等时即为对动态范围充分利用,有可能实现去雾成像的极限条件。

根据对比度随光学厚度衰减的规律,有:

由此可得对动态范围为DR的探测器,可能实现成像的极限光学厚度为:

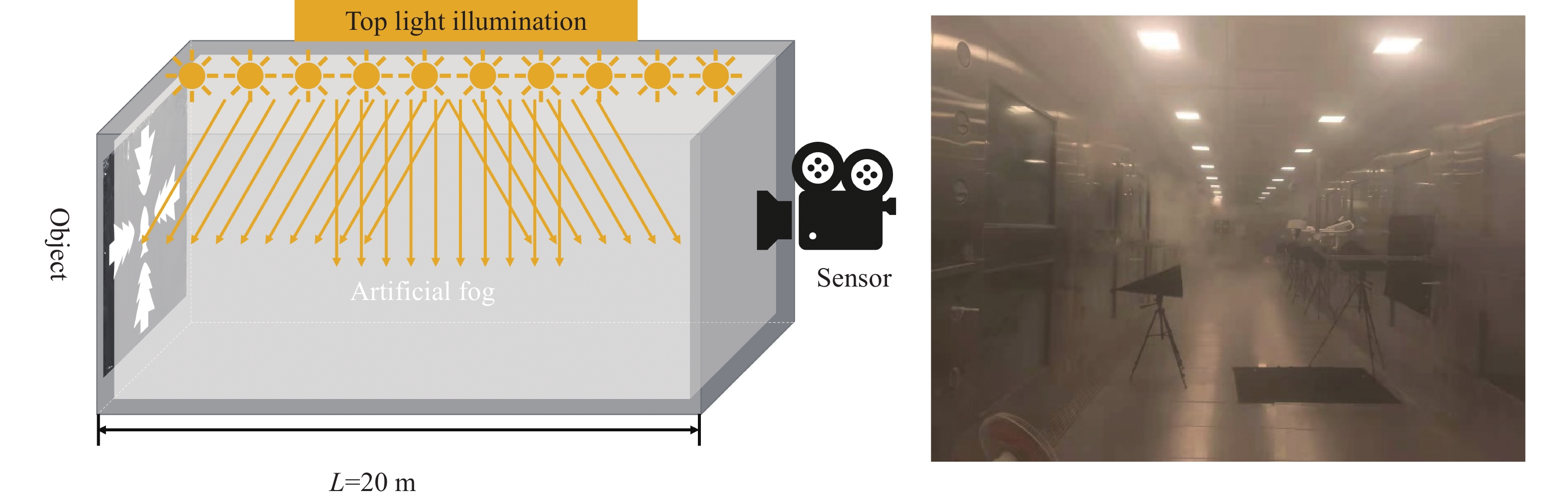

利用中国气象局物资管理处的能见度实验室,建立了20 m的人造雾气环境对以上关系进行验证。采用表1所示三种不同动态范围的相机进行实验,能见度测量精度1 m,雾舱结构示意图与内部实景如图2所示。雾气稳定时,分别使用三个相机拍摄不同能见度下的目标图像,并明确其能成功透雾成像的极限能见度。图像拍摄后,均使用直方图均衡化算法进行处理,以极限对比度为恢复能力判据,获得了各相机数据可以实现成像的极限能见度,见表1。

Camera model Hamamatsu C11440-22 CU FLIR Blackfly S

BFS-U3-51 S5Basler acA2040-90 uc Sensor type sCMOS CMOS CMOS Sensor model N/A Sony IMX250 CMOSIS CMV4000 Full well capacity/e− 30000 10330 11900 Readout noise/e− 0.8 2.3 13.8 Dynamic range 37500∶1 4491∶1 862:1 Pixel bit depth/bits 16 10, 12 16 The lowest visibility of imaging can be achieved/m 7 10 12 Table 1. Camera parameters for the experiment

成像极限能力效果如图3(a)~(f)所示。实验中FLIR相机与Basler相机的实际利用动态范围都小于标称值。这是由于两款相机的曝光控制较差,难以调整合适曝光量使得其逼近满阱而不过曝。而Hamamatsu相机曝光控制精度高,实际可用动态范围更容易贴近标称值。如图3(g)所示,实验结果与理论模拟吻合良好,其实现的极限动态范围-能见度透雾成像关系与理论值基本一致。动态范围越大,其恢复质量越好,能实现透雾成像的极限能见度越低。

Figure 3. (a), (b) Hamamatsu C11440-22 CU original image and recovery results at 7 m visibility; (c), (d) FLIR Blackfly S BFS-U3-51 S5 original image and recovery results at 10 m visibility; (e), (f) Basler acA2040-90 uc original image and recovery results at 12 m visibility; (g) Relationship between optical thickness of the medium and dynamic range. The red line is the theoretical relationship calculated by Equation (9), and the black point is the experimental results in fog cabin

-

为了突破相机的成像极限,一般依循两种思路展开研究:一是利用成像光场的多参量信息,采用光学手段滤除散射干扰光的影响,提高探测器接受到目标光信号的信噪比;二是尝试从散射光中提取信息,对散射光形成的散斑进行解译,将噪音信号转化为信息信号,实现最终成像的信噪比提升。

偏振光成像通过利用目标信号光和大气散射干扰光的偏振差异性,实现两者的分离,并滤除大部分干扰光的影响,从而实现成像信噪比提升,在低照度、低能见度环境下具备复杂目标的探测和识别能力[13]。光在透过气溶胶或浑浊水体时,会被介质中的杂质粒子反射和散射,这在一定程度上会导致获取图像的模糊、对比度降低和信息退化。一般情况下,后向散射光和反射光具有不同的部分偏振性。反射光的偏振度由物体表面的光学特性决定,而散射光的偏振度则与粒子的大小和碰撞特性有关。其中,反射光与散射光之间的偏振信息存在差异,偏振技术可以改变接收到的反射光和散射光的相对比例,从而降低噪声,提高图像的对比度[14]。

对于不同波长的光波,大气衰减系数βλ、大气能见度Vλ随波长的关系如下[15]:

式中:0.05为人眼分辨能力对应的对比度阈值;q是散射粒子尺寸分布的相关系数(q≥0)。可见,当光波的波长越长,其衰减系数越小,即图像对比度随距离衰减越慢,成像装置有效作用距离越长。例如在1064 nm波长,能见度可以是可见光波段的三倍。因此,红外成像是目前进行透雾成像的主要技术手段[16]。

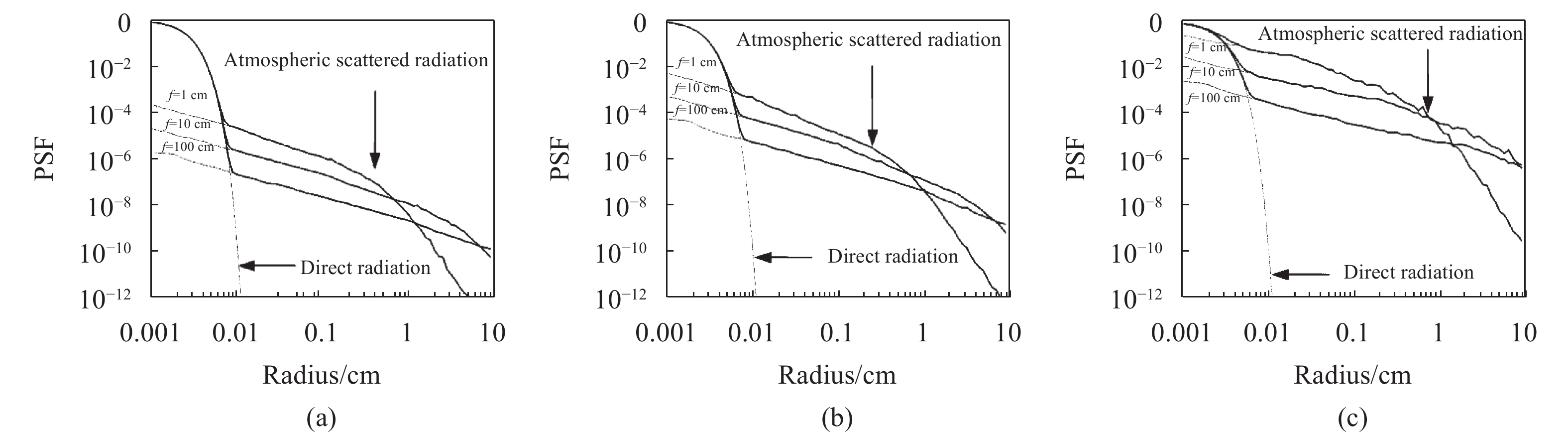

对散射光传输特性及其与光学成像系统的耦合进行理论研究,可以从光学系统设计上为成像信噪比的进一步提高提供解决方案。然而,由于大气散射介质的复杂性,从解析上求解辐射传输方程显然难度较大,因此目前主要使用蒙特卡洛法对散射介质中的光子传输进行仿真。Ben Dor等[17]在1997年利用半解析蒙特卡洛法对散射光和光学系统的耦合问题进行了研究,该模型分析了成像链路的光学厚度、成像焦距如何影响探测器测得的点扩散函数。如图4所示,其研究结果表明,增大光学系统成像焦距可以有效降低散射光对成像过程的影响。

Figure 4. Simulated normalized PSF of imaging systems (sensor size is 15 μm, the number of pixels is 512, and the optics diameter is 4 cm) operating in the visible wavelength (550 nm) for three focal lengths: 1, 10, and 100 cm. The aerosol models used are (a) tropospheric aerosol (visibility of 50 km): τ=0.078 and ωt0=0.97; (b) rural aerosol (visibility of 5 km); τ=0.78 and ωt0=0.96; and (c) radiation fog (visibility of 0.5 km); τ=7.8 and ωt0=1.0 (τ is the atmospheric optical depth, and ωt0 is the ratio of the extinction coefficient to the scattering coefficient)[17]

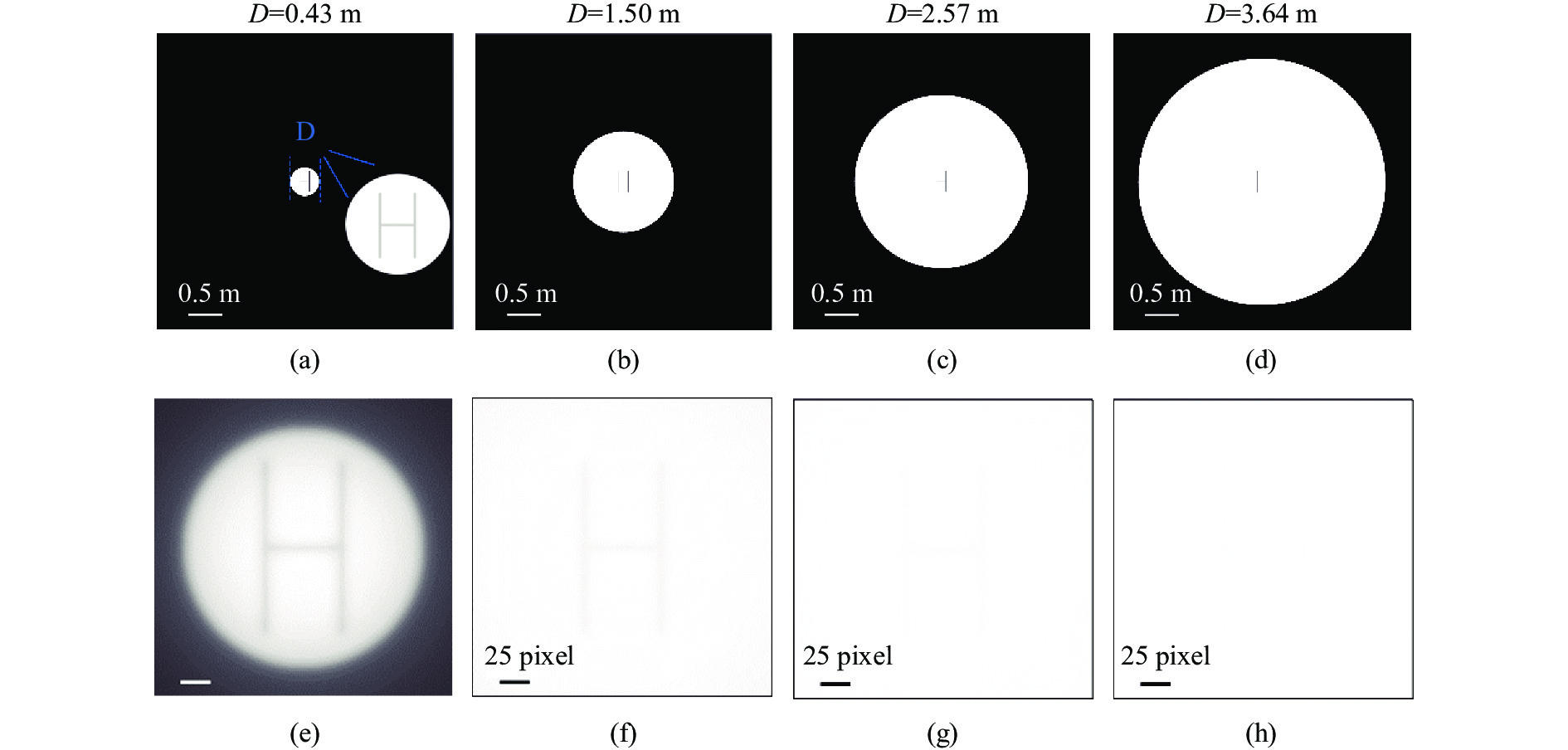

进一步可以分析浓雾条件下目标图像对比度的退化过程。模拟中发现,随着物体尺寸的增加,物体自身信号退化所形成的散射光会产生足以掩盖未退化信号的背景噪音,这一效应被称之为“光学自掩盖效应”[18]。假设有一个目标“H”放置在圆形发光区域的中心,只需改变目标在发光区的占比即可使构成不同的扩展物体。一方面,随着光照区域的扩大,由于每个发光源产生的散射信号增加,背景变得更加强烈。另一方面,成像“H”利用的是弹道光子,并且其信号强度保持恒定,故随着照明面积的增加,图像对比度降低,最终低于成像系统检测阈值,图像“H”不再可见,同时“H”也无法用任何图像处理算法恢复。图5(e)~(h)显示了在4 m能见度的浓雾下20 m成像距离的仿真结果。结果表明,在自发光范围小时,目标在发光范围内的占比较大,目标“H”的轮廓可以清楚地与圆形背景区域区分开来。图5(f)~(h)中可以发现,随着照明区域的扩展,目标在发光范围内的占比逐渐变小,目标“H”逐渐淹没在背景中。总结来说,来自目标的光通过低能见度的大气后成为一个掩盖信号,干扰目标本身的识别,产生光学自掩盖效应。

Figure 5. Simulation results at 4 m visibility[18]

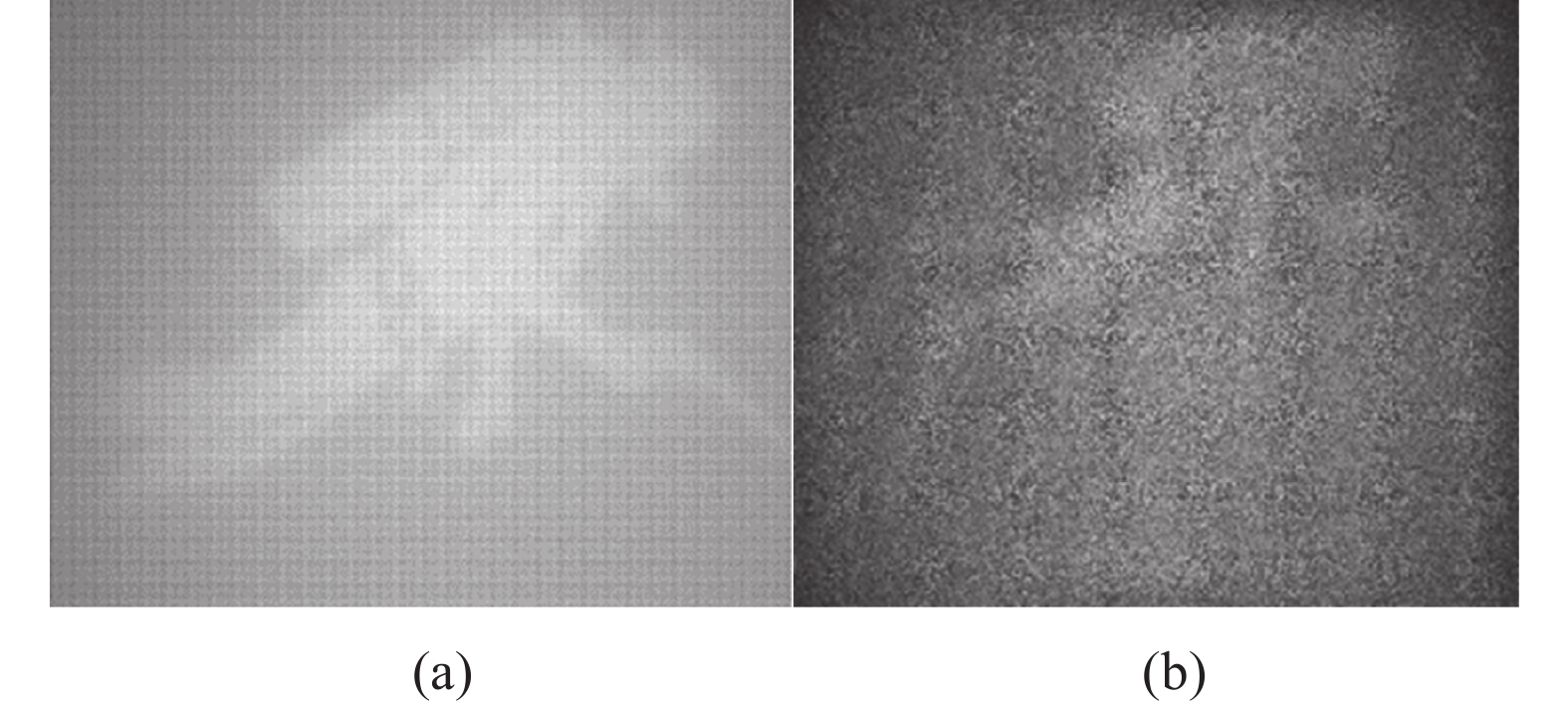

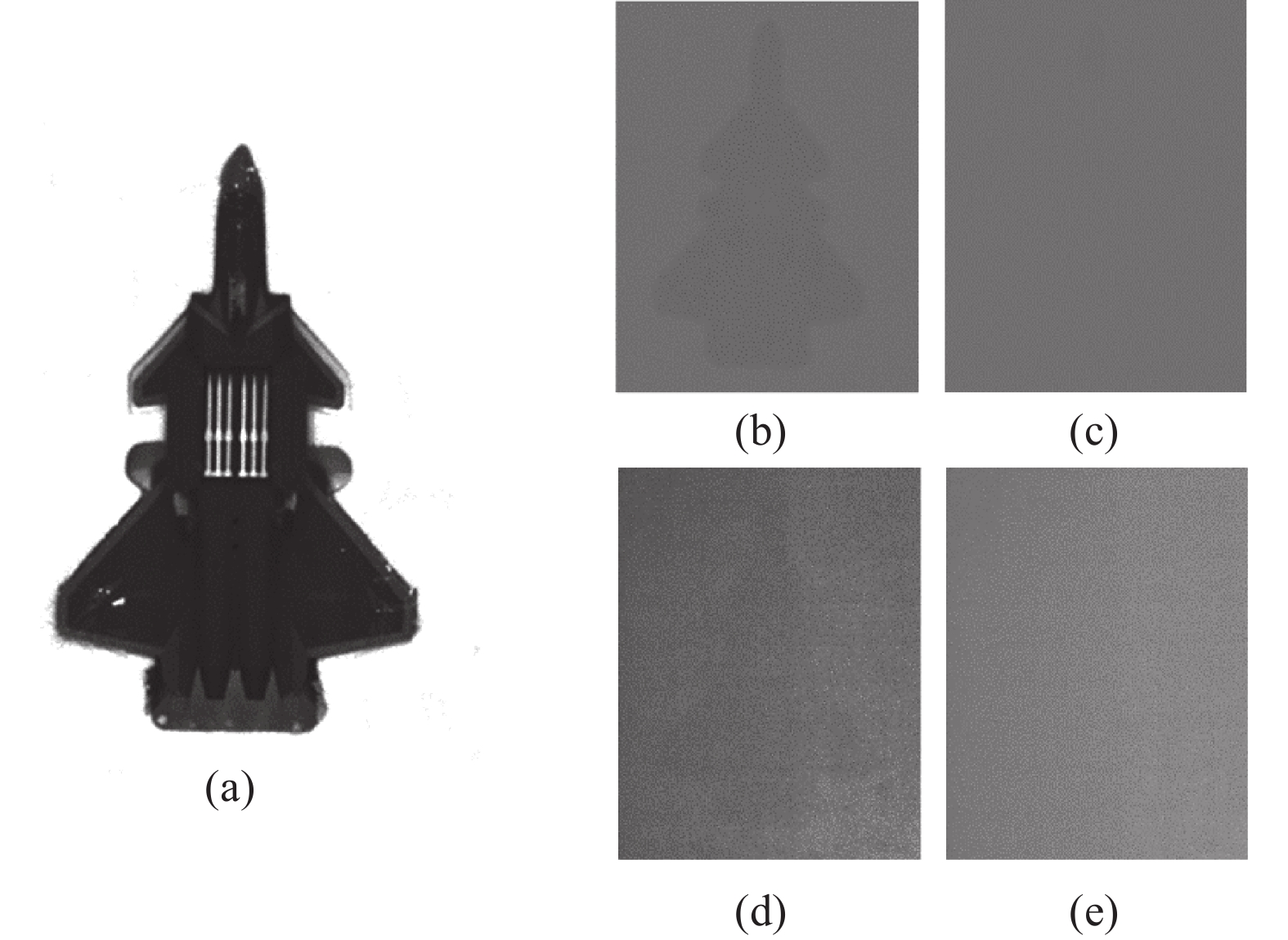

通过水下(图6)和雾舱(图7)验证实验可见,当散射介质的光学厚度逐渐增大时,目标中的高频细节特征会首先消失,而轮廓特征最后消失,这意味着单一的全视场对比度衰减无法作为一个好的衡量介质浑浊程度的参量。随着能见度的降低,目标的可识别性会降低,直到它的纹理结构全部消失导致其无法被识别。实验和仿真均可以说明,来自被照亮物体的散射光会聚合成强烈的背景,因此无法观察到封闭的结构。如图7(c)、(e)所示,随着能见度的降低,目标完全被散射背景覆盖。在极低的能见度下,光学自掩盖效应是导致目标无法识别的主要因素,来自照明的散射光分量和目标本身的弹道光分量重叠,导致目标对比度降低。通过实验观察,笔者可以解释为,封闭的结构内部比其边界更有可能被浓雾淹没。这是由于光学成像主要依赖雾中的弹道光子,因此散射光子产生的背景会降低光学图像的对比度。这种光学自掩盖效应在观察大气中不完全光学成像中起着不容忽视的作用,同时,它的产生机制可以作为强散射介质下光学成像重建的指导。

Figure 6. Underwater imaging results, extinction coefficient is 0.97 m−1.(a) Imaging result at a distance of 6.7 m; (b) Imaging result at a distance of 8 m

Figure 7. (a) Clear image of the target; (b), (c) Simulation imaging results at 8 and 7 m visibility, corresponding; (d), (e) Experimental results at 20 m at 9 and 8 m visibility, corresponding[18]

如第一部分所述在被动照明条件下,光学上的信噪比对透过散射介质成像存在物理极限,为了突破此极限,收集散射光并对散射光信号进行解译[19-20],将原本的背景噪音转换为信号,是实现信噪比提升的另一种思路。众多实验表明:散斑相关的方法能够较好地利用散射光子实现透过散射介质成像,近年来受到越来越多的关注。

散斑相关成像技术基于光通过散射介质后散斑分布的一阶相关性,利用散斑相关成像方法包括浴帘效应、记忆效应等,在非侵入式、三维、实时成像等方面有很大进展。光学记忆效应是指在一定的入射角范围内,若入射光场转动一个小角度,其出射光场将相应转动,经过散射介质所形成的散斑形态不发生变化,散斑图案仿佛是存在于介质中的记忆。2014年,Katz等[5]直接采用空间非相干光照射物体,提出了单帧散斑自相关的成像方法,实现单张散斑图案对物体图像的恢复。在记忆效应范围内,尽管入射光的角度发生变化,散斑图案基本保持不变,仅仅发生相应的横向位移,不同角度入射光投射到同一像面的散斑图案之间存在很大的相关性。因此,在记忆效应范围内,散射系统可认为是线性平移不变系统,成像过程可以用一个点扩散函数来描述。散射介质所在的光学系统拥有一个或数个点扩展函数。该点扩展函数相当于是空间弥散的散斑分布。点扩散函数在记忆效应范围仍然满足线性平移不变性,因此,当采用非相干光照明时,成像的强度分布(散斑)可以表示为物函数和系统(强度)点扩展函数的卷积[21]。

2016年,Zhuang等人[22]完成了透过标准散射介质采集点扩散函数的成像实验。实验结果表明,可利用在散射成像恢复的记忆效应范围约为±75 mrad。这意味着,视场范围在20 m基线下能够对直径3 m的物体进行成像,这样的成像视场对于实际应用非常可观。2018年,Xu等人基于参考物的非侵入式散射成像思路,实现了不同深度平面的恢复成像[23]。

目前在实际水体和大气环境中,由于照明光场的非相干性,以及散射介质的高速时变特性,导致高相关性散斑几乎不可能出现,散射光信号难以解译。因此,在大气和水体中透过散射介质实现成像主要途径还是依赖弹道光成像。

-

图像叠加是实现图像信噪比提升的一种简单直接的方法。多帧图像叠加[24]可以延长等效曝光时间以收集更多的光子,从而获取更多的有效信息,由此可显著提升成像系统的透雾能力。同时,帧累积通过抑制噪声方差对图像去噪,最终提高灰度分辨率和信噪比(SNR)。多帧图像叠加的前提是一组匹配的图像,但是,帧累积是在相对静止的平台上进行,对于实际应用场景,相机和物体通常无法保持相对静止,故通常需要进行多视图像的融合。首先,多视图像的匹配往往依赖于基于灰度的匹配算法和基于特征点的匹配算法,但是,在类似于浓雾的低能见度条件下无法很好应用。运动时获取的图像信息由于图像失配,帧累积不能直接运用,雾中校准相机位置和稳定指向方向也是同时存在的挑战。

因此,有研究提出了一种融合和积累浓雾中不可见目标的多视点模糊图像新技术[25],其中能见度范围内的近距离物体可见,而能见度以外的远处目标则不可见。在这种情况下,像素携带相机的位置和指向信息,可以在近距离物体的多视图可见图像的帮助下进行校准。通过使这样的位置和指向参数,计算外参数矩阵并将其应用于可见范围之外的不可见目标的图像融合,其中采用了如图8的多视投影几何模型。实验表明,多视点成像利用非共面物体作为先验信息,可以实现运动平台上相机位姿的精确提取,对远处不可见物体的图像进行融合,以提高图像的灰度分辨率和信噪比。实验验证了进行多视点图像融合的去雾能力,而且随着更多视点图像的融合,可以实现更好的去雾效果。如图9所示,与单图去雾结果(图9(a))对比,图9(b)~(d)中保留了更详细的信息和边缘,意味着多视图图像融合的合成图像增强了图像对比度,有效地抑制噪音。此技术被证明可以实现多视光学图像融合和恢复浓雾中的远距离目标,克服了相机移动时图像不匹配的问题。通过使用非平面对象作为先验信息的平台,这种技术对恶劣天气下的目标图像获取有重要作用。如上所述,在低能见度条件下,图像对比度降低,无法实现图像特征点的识别,只能通过相机的特性和位姿参数测量进行图像配准,然而目前的位姿测量技术在精度和数据输出率上仍难以有效满足像素级图像配准的要求。采用不同类型的探头可以获取复杂动态环境中可见光、热量等信息,但异质图像的特征点无法准确识别,增大图像融合难度,也存在动态范围有限的问题。因此,亟需发展新的图像融合理论,以降低融合过程中对图像配准精度的要求。

Figure 8. Schematic diagram of multi-view projection geometry[25]

Figure 9. Fusion experimental results. (a) Single viewpoint defogging; (b) 4 viewpoints fusion defogging; (c) 7 viewpoints fusion defogging; (d) 10 viewpoints fusion defogging; (e) The relationship between the number of fused viewpoint and corresponding structural similarity (SSIM)[25]

-

双目视觉具有反应灵敏、感知准确、与人类视觉感知高度协同、功能强大的特点,双目立体视觉可以为多源信息融合提供一种更高维度的融合空间。一般来说,信息传输所受的干扰通常跟在复杂环境中的传输距离有关系,越靠近信息采集者的事物,受到的干扰越少。立体视觉系统的主要功能是构建与复现世界的三维场景。根据Marr的理论[26],视觉是从图像中感知目标特性和实现目标定位的过程。因为空间的三维性,所以人类视觉的感知必须有三个维度。但外部环境图像信息是以二维的形式投影到双眼的视网膜上,纵深信息作为第三维在投影过程中丢失。人类视觉系统通过对双目视差图像的分析实现从二维图像转换为对环境的三维表征。

这样一种通过纵深信息恢复实现对三维世界进行重构的机制称为立体视觉(Stereopsis)。深度信息的来源可以分为四类[27]:

(1) 视觉信息(Ocular information):眼睛调节(Accommodation)与辐辏(Convergence)。

(2) 立体信息(Stereoscopic information):双眼视差。

(3) 动态信息(Dynamic information):动态视差(Motion parallax)。

(4) 图像信息(Pictorial information):遮挡、相对大小。

对于一般的光电传感器,通常只能获得平面强度信息,场景的深度信息往往只能通过遮挡效应等单目线索间接获得,存在较大误差,无法为事物的跟踪和分辨提供有效的辅助作用。双目立体视觉能够从不同角度获得同一区域的信息,大幅度提高对图像深度信息估计的准确度,对复杂动态场景成像识别和跟踪提供更有效的辅助。光学成像一般是在平面模式下记录并展示,但成像最终效果取决于再现与展示方式,是由视觉神经感知决定。在生物感知的过程之中,物理恒定的刺激也会导致感知波动,存在着机器视觉所难以达到的捕获的双目竞争、对比度掩蔽、运动致盲和闪光抑制等多稳态优势感知模式。抽象来说,双眼并不是简单地感知两种刺激的稳定的单一叠加态,实际上是随着时间的推移,随着两种刺激争夺感知优势,感知意识发生变化。

近期项目团队的初步研究结果发现,对于多视角所采集得到的事物,如果能够使用三维显示技术或虚拟现实(VR)直接观看,能够为观察者提供更宽广的视野、更高的图像亮度和反衬度,能够部分绕过遮挡物体[28-30]。传统的望远侦察与监控系统,采用手持望远镜,放大倍率有限,而高放大倍率的望远装置,需要克服抖动与链路干扰,尤其是复杂环境中的雾霾、湍流、尘土等,对光学成像造成极大的影响。更新的研究结果发现,通过双目视觉的合成在一定程度上能够减少因为相机抖动而引起的不稳定,甚至可以有效地克服湍流的影响,获得更好的图像质量[31]。

机器视觉以人类视觉为目标,试图使机器获得人类智能的能力。采用摄影机和电脑代替人眼与人脑对目标进行识别、跟踪和测量,并进一步做图形处理,使电脑处理成为更适合人眼观察或传送给仪器检测的图像。在进行物体探测与目标识别任务时,虽然主动3D扫描仪利用如激光雷达[32]和结构光[33]等技术可以用于直接深度采集和非视域成像探测[31],但从立体相机的画面中分析双视图的视场,从而计算感知深度是一个更经济有效的解决方案。然而,对于深度识别的计算机视觉研究,在低能见度、遮挡干扰、无纹理物体的情况下,很难抉择准确的双视图差异。目前,双目视觉去雾算法将立体匹配定义为一种有监督的学习任务,反复结合去雾算法进行优化,而这需要利用大量的训练数据和更高效的计算硬件。此外,受计算机数据库内容的限制,对于陌生环境和新发现的物体,计算机视觉无法做到精准识别,整体工作效率暂时不能达到人眼识别的同样效果。在笔者的初步研究中发现,在成像-显示-感知链路中,人类视觉的介入能实现细微深度差的有效分辨。在强散射背景下,机器视觉功能极易丧失,但人类视觉的分辨能力却反映出了极高的鲁棒性。在笔者的初步研究中,人类立体视觉显示出了图像自动融合、分辨率提高等优点,展现出了人类视觉研究在全链路优化中的不可替代性。发展基于人类视觉的成像-显示新技术是充分利用并融合机器视觉技术与人类感知能力的新前沿。

但是,人们发现立体图像的感知十分复杂,其感知质量与双眼图像相关[34]。应对不同的图像降质情况,人眼视觉系统有完全不同的响应特性,这使得对立体图像的衍生技术能力评价变得困难。如何定量衡量立体视觉对图像信息的的感知和融合的增强幅度也需要进行更深入的探索。相关的研究应建立在光学领域的基础上,结合视觉医学、神经反应表征等,实现跨学科的交叉融合突破、成像-显示技术的全链路优化。

-

文中主要对透过散射介质实现光学成像的主要技术难点和可能实现的方法进行了分析和综述。作为图像信息的最终使用者,人类视觉系统在低能见度条件下的图像信息获取中的作用却被长期忽视。散射介质中的光传输、收集、探测、处理与人机交互再现是一个相互耦合的过程,需要作为一个整体进行全链路优化。目前,相关研究才刚刚起步,立体视觉形成的关键因素、视觉效果评价指标、再现与采集间的相互优化等问题都存在大量的研究空白,需要进行深入的研究。

Image perception, fusion and visualization technology in strong scattering condition

doi: 10.3788/IRLA20220418

- Received Date: 2022-06-18

- Rev Recd Date: 2022-07-14

- Available Online: 2022-08-31

- Publish Date: 2022-08-31

-

Key words:

- scattering imaging /

- image fusion /

- stereoscopic vision /

- perceptual enhancement

Abstract: Visual information is an important means for human beings to perceive the surrounding environment. With the great expansion of human “field of view” by optical imaging and image processing technology, the way people acquire images has broken through the limitations of the naked eye. The scattering effect leads to a significant decrease in the working distance of the optical imaging system, making it difficult to effectively observe long-range targets. Human perception of image information is usually completed by focusing, correction and stereoscopic view synthesis, which are coupled with each other. Among them, the processes of focusing and binocular image information correction can be optimized by means of optical systems and digital image processing. With the improvement of contrast under strong scattering background, the image information under scattering conditions can be perceived and analyzed. However, limited by current technology, the ability of machine stereoscopic vision is difficult to reach human level, resulting in the human visual system still being an important terminal for image perception and analysis. It is foreseeable that in order to achieve accurate acquisition and analysis of optical image information under low visibility conditions, it is still necessary to develop a global optimization technology for stereoscopic vision through the combination of human vision and machine. This study mainly introduces the physical limitations and key factors influencing the optical imaging and image fusion under turbid atmosphere or water, and presents an outlook on the role of human stereopsis in improving optical imaging capabilities.

DownLoad:

DownLoad: