-

合成孔径雷达(SAR)可在恶劣气象、天候条件下工作,对于常态化的侦察监视具有重要的潜在价值[1]。SAR目标识别技术通过对图像中目标特征的分析,判定其所属目标类别。特征提取是SAR目标识别中的关键步骤之一,主要获取图像中目标的简介、有效描述形式。现阶段,用来描述SAR图像中目标特性相关特征的方法主要有几何形状类、投影变换类以及电磁类。参考文献[2-3]将目标轮廓、区域等用于SAR目标识别,充分利用它们在描述目标外形分布上的优势。投影变换特征可进一步归纳为两类。一类通过流形学习等数学变换算法对SAR图像进行处理,典型代表是非负矩阵分解(non-negative matrix factorization,NMF)[4]等。另一类是通过信号处理算法进行图像分解,典型代表是单演信号[5]等。电磁类特征主要是考察目标在特定雷达频段的相关特性,如峰值[6]、散射中心[7]等。分类器是SAR目标识别方法的另一关键步骤,通过设计分类机制对提取特征进行类别判定。大量分类器在SAR目标识别中进行了实验和验证,如参考文献[8]采用的支持向量机(SVM)以及参考文献[9]采用的稀疏表示分类(SRC)等。近年来,随着深度学习技术的成熟,基于深度模型的SAR目标识别方法得到广泛深入研究,其中最具代表性的是卷积神经网络(CNN)[10-12]。

特征提取的结果作为分类器的输入很大程度上决定了分类结果的准确性。因此,通过设计提出新的SAR图像特征提取方法对于目标识别意义重大。文中提出基于复数经验模态分解(C-BEMD)的SAR目标识别方法[13]。C-BEMD是传统BEMD[14-17]在复数域的扩展,可直接用于复数图像的处理和分析。参考文献[17]就是使用传统BEMD进行SAR图像分解及目标识别。事实上,SAR图像本身为复数矩阵,具有幅度和相位信息。传统方法中单纯使用幅度信息会在一定程度造成信息缺失。因此,通过C-BEMD可更为有效地反映目标的二维时频特征,从而为后续分类提供更充分的信息。针对分解得到的二维内蕴模函数(BIMF),文中在分类阶段采用联合稀疏表示进行决策。联合稀疏表示基于稀疏表示原理实现多模态表示的同时求解,能够在保持效率的前提下提升重构精度。最终,根据联合稀疏表示的输出误差进行类别的判定与决策。实验依托经典的MSTAR数据集,分别在标准操作条件(SOC)和扩展操作条件(EOC)下开展。根据结果可得出结论,方法具有良好的识别性能。

-

经验模态分解(EMD)是一种自适应多尺度的一维信号处理算法,具有良好的空间和频率特性[14]。经过EMD分解后的信号被表征为若干个同尺寸的内蕴模函数(IMF)。基于分解得到的IMF可更为有效地对原始图像进行分析。对于一个输入的一维型号

$S$ ,EMD的分解结果表述如下:$$S = \sum\limits_{j = 1}^n {{I_j} + r} $$ (1) 式中:

${I_j}$ 为原始信号的第j层IMF;$r$ 为最终的分解残差。经过分解得到的各个IMF近似正交,因此EMD分解可以有效降低原始信号的冗余。由于EMD具备的诸多优点,其在语音、地震信号处理等领域均取得有效运用并证明了有效性。为有效处理二维信号,研究人员又对传统EMD进行了进一步扩展和完善。

-

传统的EMD以及拓展到二维的BEMD均是针对实信号设计的,不能处理复数信号或图像。BEMD将输入图像分解为若干个BIMF,实现二维时频特性的描述。Yeh将BEMD推广到复数域,使其具备对复数矩阵的直接分解能力。根据参考文献[13],复数二维经验模态分解(C-BEMD)算法的具体实施过程归纳如下:

(1) 构造二维带通滤波器

$$B = \left[ {\begin{array}{*{20}{l}} {{H_{m \times n}}}&{{O_{m \times (N - n)}}}\\ {{O_{(M - m) \times n}}}&{{O_{(M - m) \times (N - n)}}} \end{array}} \right]$$ (2) 式中:

${H_{m \times n}}$ 表示一个$m \times n$ 大小的矩阵。其中,${O_{p \times q}}$ 代表大小为$p \times q$ 的全0矩阵;$m$ 和$n$ 确定如下:$$ m = \left[ {\frac{{M + 1}}{2}} \right]\;\;\;\;n = \left[ {\frac{{N + 1}}{2}} \right] $$ (3) (2) 构造4个解析信号

$$ \begin{array}{l} {G_1}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}}) = A({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})F({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})\\ {G_2}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}}) = A({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})F({{\rm {e}}^{{\rm{ - }}ju}},{{\rm {e}}^{jv}})\\ {G_3}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}}) = A({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})F({{\rm {e}}^{ju}},{{\rm {e}}^{{\rm{ - }}jv}})\\ {G_4}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}}) = A({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})F({{\rm {e}}^{{\rm{ - }}ju}},{{\rm {e}}^{{\rm{ - }}jv}}) \end{array} $$ (4) 式中:

$F({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})$ 为输入二维信号$f(x,y)$ 的二维傅里叶变换。(3) 分别获取

${G_1}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})$ 和${G_4}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})$ 二维逆傅里叶变换的实部,记为${\bar g_1}(x,y)$ 和${\bar g_4}(x,y)$ 。分别获取${G_2}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})$ 和${G_3}({{\rm {e}}^{ju}},{{\rm {e}}^{jv}})$ 二维逆傅里叶变换的虚部,记为${\bar g_2}(x,y)$ 和${\bar g_3}(x,y)$ 。(4) 采用传统BEMD分别对

${\bar g_1}$ ,${\bar g_2}$ ,${\bar g_3}$ ,${\bar g_4}$ 进行处理,对应获得的BIMF分别记为$\bar g_1^{(k)}$ ,$\bar g_2^{(k)}$ ,$\bar g_3^{(k)}$ ,$\bar g_4^{(k)}$ ,对应的BIMF个数分别记为${N_q}$ ,$q = 1,2,3,4$ 。(5) 采用

${\rm{FQO}}$ 对$\bar g_q^{(k)}$ 进行处理,从而获得相应的复数BIMF$$\bar g_q^{(k)}{\rm{ = FQO}}(\bar g_q^{(k)}(x,y))$$ (5) 其中,

${\rm{FQO}}$ 函数定义如下:$${\rm{FQO}}(f(x,y)) = \frac{1}{4}\left[ {f(x,y) - {f_1}(x,y) + j({f_x}(x,y) + {f_y}(x,y)} \right]$$ (6) 式中:各成分含义具体参见参考文献[20]。

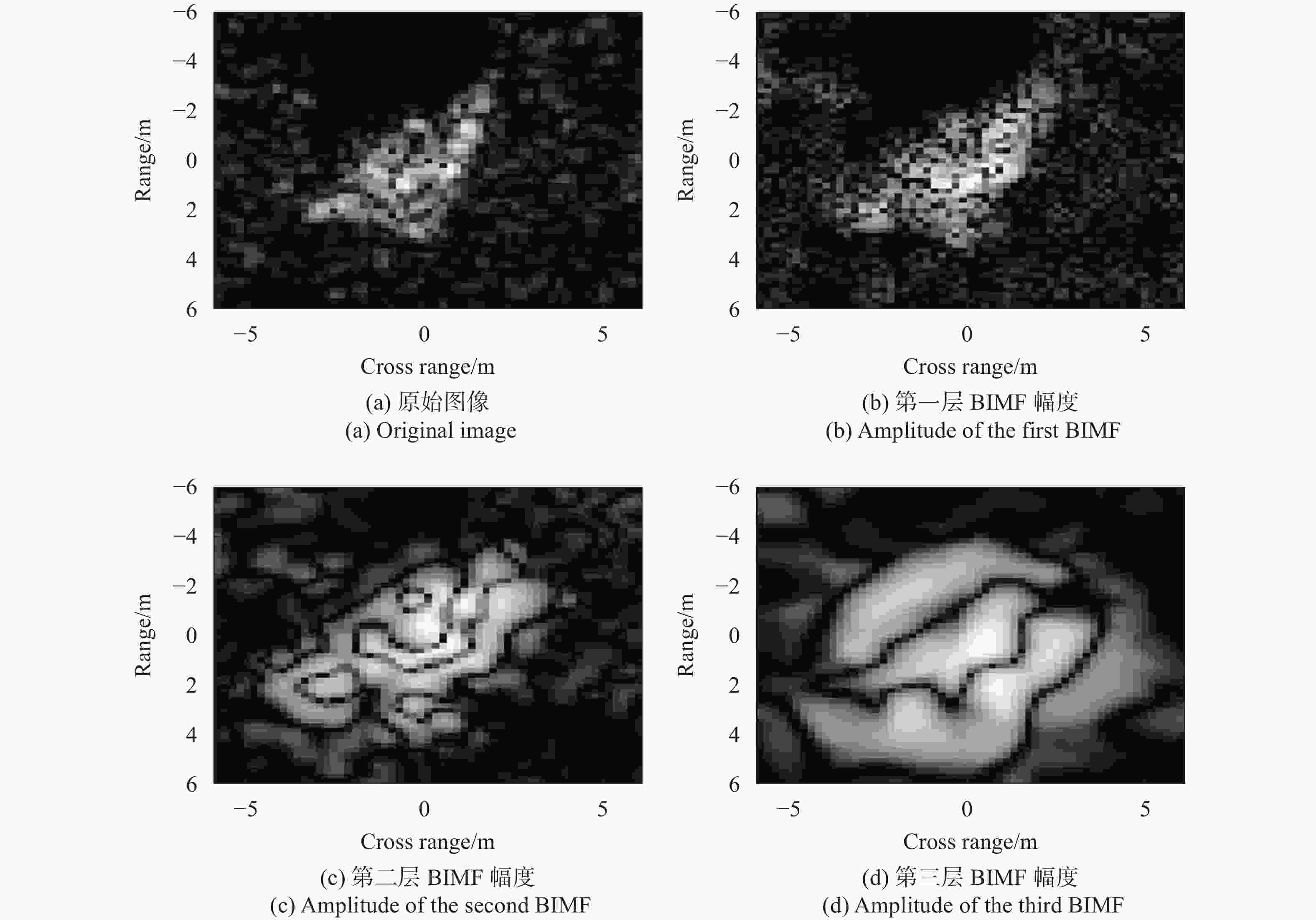

文中将C-BEMD应用于复数SAR图像的分解,通过多层次BIMF描述原始图像的二维时频特性,为后续的分类决策提供有效输入。图1对一幅MSTAR数据集中的SAR图像进行分解,产生如图1(b)、(c)、(d)所示的分解结果(幅度部分)。可以看出,分解结果可有效描述目标相关联的特性,同时与原始图像形成有效互补,提供更多的细节信息。为此,文中运用分解的多层次复数BIMF进行SAR目标识别。

-

对于C-BEMD分解得到的多层次BIMF,文中采用联合稀疏表示作为基础分类器进行分析和决策。联合稀疏表示作为传统SRC的多任务扩展,具备同时考察多个稀疏表示任务内在关联的能力[3,5,18]。对于待识别的SAR图像

$y$ ,假定C-BEMD分解得到$K$ 个BIMF成分(含幅度和相位)为$\left[ {{y^{(1)}}{\rm{ }}{y^{(2)}}{\rm{ }} \cdots {\rm{ }}{y^{(K)}}} \right]$ ,对它们进行稀疏表示如下:$$ {y^{(k)}} = {A^{(k)}}{\alpha ^{(k)}} + {\varepsilon ^{(k)}}\;\;\;(k = 1,2, \cdots ,K) $$ (7) 式中:

${A^{(k)}}$ 对应第$k$ 分解成分的字典;${\alpha ^{(k)}}$ 为相应的系数矢量。各个稀疏表示问题的最佳稀疏矢量通过最小化重构误差进行求解:

$$\mathop {\min }\limits_\beta \left\{ {g(\beta ) = \sum\limits_{k = 1}^K {\left\| {{y^{(k)}} - {A^{(k)}}{\alpha ^{(k)}}} \right\|} } \right\}$$ (8) 式中:

$ \beta = \left[ {{\alpha ^{(1)}}{\rm{ }}{\alpha ^{(2)}}{\rm{ }} \cdots {\rm{ }}{\alpha ^{(K)}}} \right]$ 。公式(8)中的目标函数并没有考察不同分解成分之间的内在关联,因此其求解结果不是最优的。为此,通过对系数矩阵

$\beta $ 进行约束,可进一步获得更为可靠的结果:$$\mathop {\min }\limits_\beta \left( {g(\beta ) + \lambda {{\left\| \beta \right\|}_{2,1}}} \right)$$ (9) 通过

${\ell _{\rm{1}}}/{\ell _2}$ 范数对矩阵$\beta $ 的约束,可使得不同分解成分的系数矢量趋近于相似结构,反映它们的内在关联。针对公式(9)中的问题,现阶段已有较为成熟的求解算法[3, 5],如贝叶斯多压缩感知、同时正交匹配追踪等。由于同时正交匹配追踪算法效率相对较高,文中选其作为联合稀疏表示问题的求解算法。在求得各层次BIMF对应的稀疏系数矢量的基础上,可按照公式(10)进行类别决策。$${\rm{identity}}(y){\rm{ = }}\mathop {\min }\limits_i \sum\limits_{k = 1}^K {\left\| {{y^{(k)}} - A_i^{(k)}\alpha _i^{(k)}} \right\|} $$ (10) -

图2显示了提出方法用于SAR目标识别的基本流程。首先,采用C-BEMD对训练样本进行分解处理,将其多层次BIMF分别构建全局字典。利用相应的C-BEMD算法对测试样本进行相应分解得到对应层次的BIMF。然后,将测试样本的BIMF在构建字典的支持下进行联合稀疏表示。最终,根据重构误差的大小判定测试样本的目标类别。

图 2 基于C-BEMD特征提取的SAR目标识别方法

Figure 2. SAR target recognition method based on feature extraction by C-BEMD

在实际操作过程中,由于基于C-BEMD分解得到的BIMF为复数形式,存在幅度和相位两部分。文中在具体使用过程中也同样分别使用。图2中所示的K个BIMF成分来自K/2个分解结果。因此,提出方法可以充分利用复数SAR图像的二维时频特性从而提高最终的识别性能。

-

在MSTAR数据集上开展测试验证,考核所提方法的性能,其包含的10类目标示意图见图3。相应目标的SAR图像覆盖0°~360°方位角以及15°,17°,30°,45°等典型俯仰角。由于数据样本丰富,MSTAR数据集长期以来是SAR目标识别算法验证的标准数据集。文中据此设置4类测试场景,包括:标准操作条件、型号差异、俯仰角差异以及噪声干扰。

表1显示了标准操作条件下10类目标分类的训练和测试样本,分别来自17°和15°俯仰角。各类目标均来自相同的型号(不涉及多子型号的目标采用缺省符号“—”表示其固有型号),仅存在较小的俯仰角差异。因此,此时的测试和训练样本相似度较高,整体难度相对较低。型号差异条件下的训练和测试集按表2设置,共包含3类目标。其中,BMP2和T72的测试样本与训练样本来自完全不同的型号。表3显示了俯仰角差异条件下的训练集(17°俯仰角)和测试集(两个子集,分别对应30°和45°俯仰角)。此外,在表1实验设置的基础上,通过对原始测试样本进行噪声添加,构造不同信噪比(signal-to-noise ratio,SNR)的测试集,进而可以对提出方法在噪声干扰条件下的性能进行测试和验证。

表 1 标准操作条件描述

Table 1. Description of SOC

Class Training set (17°) Test sample set (15°) Configuration (SN) Scale of samples Configuration (SN) Scale of samples BMP2 9563 233 9563 195 BTR70 — 233 — 196 T72 132 232 132 196 812 195 S7 191 T62 — 299 — 273 BRDM2 — 298 — 274 BTR60 — 256 — 195 ZSU23/4 — 299 — 274 D7 — 299 — 274 ZIL131 — 299 — 274 2S1 — 299 — 274 表 2 型号差异描述

Table 2. Description of configruation variance

Class Training set (17°) Test sample set (15°) Configuration (SN) Scale of samples Configuration (SN) Scale of samples BMP2 9563 233 9566 196 C21 196 BTR70 — 233 — 196 T72 132 232 812 195 S7 191 表 3 俯仰角差异描述

Table 3. Description of pitch angle variance

Class Training set Test sample set Pitch angle/(°) Scale of samples Pitch angle/(°) Scale of samples 2S1 17 299 30 288 45 303 BDRM2 17 298 30 287 45 303 ZSU23/4 17 299 30 288 45 303 -

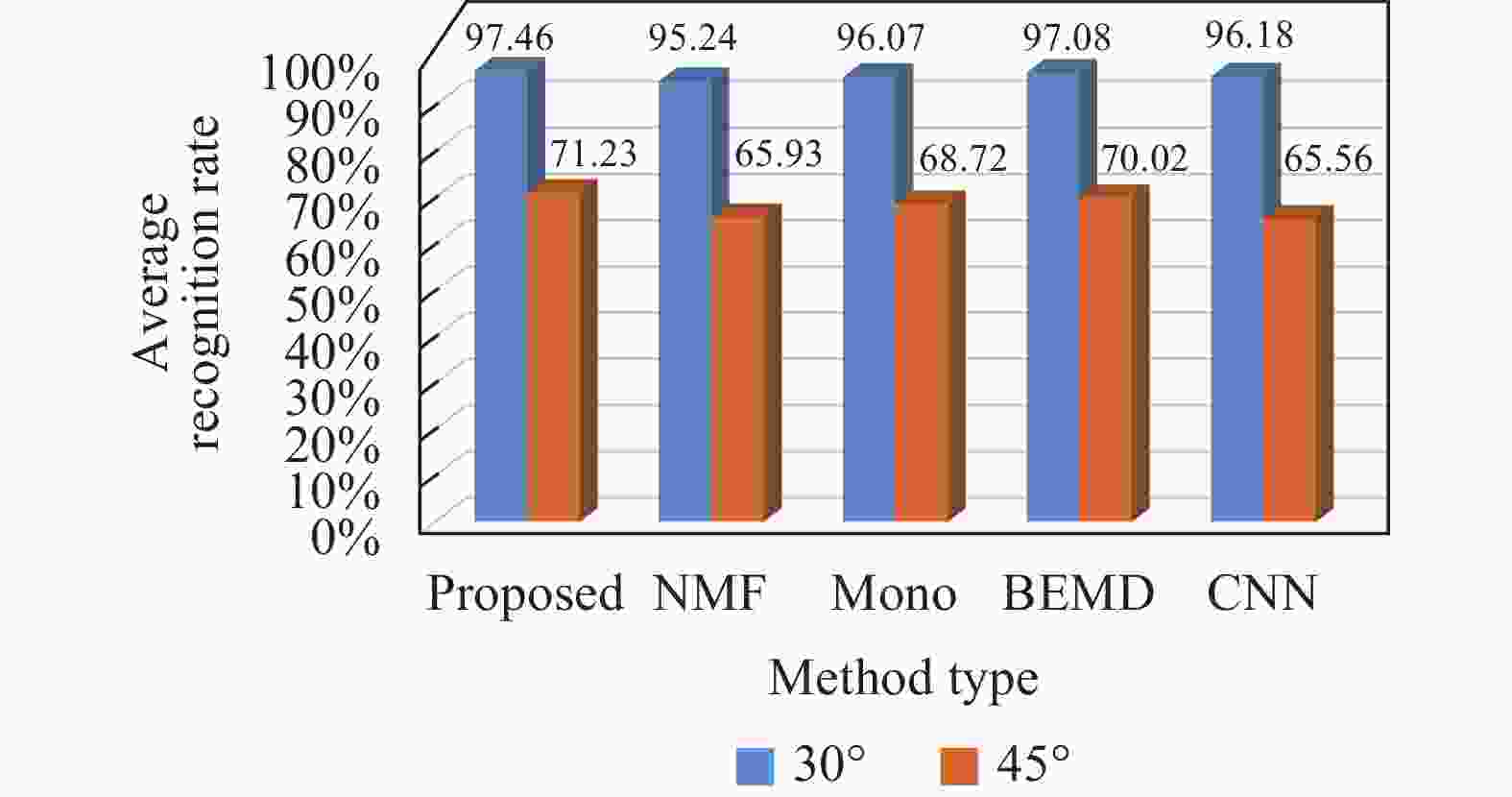

从现有文献选取4类对比方法与提出方法进行同步实验与对比,从而定量评估方法的有效性和稳健性。对比方法如下:参考文献[4]中基于NMF的方法,记为“NMF”;参考文献[5]中基于单演信号的方法,记为“Mono”;参考文献[17]中基于传统BEMD的方法,记为“BEMD”;参考文献[10]中基于CNN的方法,记为“CNN”。其中,前3类方法主要通过特征提取提高目标识别性能。CNN方法则是在当前基于深度学习模型的方法选取的代表性案例。

-

标准操作条件针对表1中的10类目标测试SAR图像进行识别。图4显示了文中方法对这10类目标的分类混淆矩阵。图中横纵坐标分别代表样本真实标签以及分类预测标准,对角线元素则为不同目标的识别率。各类方法对10类目标的平均识别率统计如表4所示。可见,各类方法在标准操作条件下均可以取得很高的识别性能。对比而言,文中方法以99.34%的平均识别率优于4类对比方法。标准操作条件下,训练样本与测试样本相似度高,能够较好涵盖测试样本中的各种情形,以及基于深度学习的CNN可以充分发挥其分类能力。特别地,与传统BEMD方法相比,文中通过采用C-BEMD更为有效地发掘了原始复数SAR图像的时频特性,获得更为有效的特征描述。因此,文中方法最终的识别性能优于传统的BEMD方法。

图 4 标准操作条件下所提方法对各类别识别结果

Figure 4. Recognition results of each class by the proposed method under SOC

表 4 标准操作条件下的结果统计

Table 4. Results under SOC

Method type Average recognition rate Proposed method 99.34% NMF 98.26% Mono 98.74% BEMD 99.04% CNN 99.08% -

依托表2中的实验设置对提出方法在型号差异条件下的性能进行测试验证。各类方法的平均识别率统计如表5所示。与标准操作条件相比,型号差异条件下的识别结果呈现几点不同。一是各类方法的识别性能均出现不同的下降。二是CNN方法的性能下降最为显著。由于训练样本与测试样本存在较大差异,训练得到的深度网络分类性能会出现下降。与传统BEMD方法相比,文中方法的识别率具有一定优势,证明了C-BEMD可以更为有效地提取SAR图像的复数域特征,从而提高整体识别性能。

表 5 型号差异下的结果统计

Table 5. Results under configuration variance

Method type Average recognition rate Proposed method 99.12% NMF 97.26% Mono 96.36% BEMD 98.27% CNN 98.68% -

依托表3中的实验设置测试文中方法在俯仰角差异条件下的识别性能。分别测试各类方法在30°和45°俯仰角下的识别结果,统计如图5所示。在30°俯仰角下,各类方法的正确识别率均能保持在93%以上,说明此时俯仰角差异带来的图像差异相对较小。对于俯仰角45°的测试子集,从识别结果可以看出此时正确识别的难度显著增大,体现了较大俯仰角差异带来的影响。在两个测试子集上,文中方法均取得优势性能,表明其更为可靠的性能。对比BEMD方法,文中方法在两个角度下性能均有较大提升,说明了C-BEMD对于SAR图像特征提取的有效性。

-

依托构造的多信噪比测试样本测试提出方法在噪声干扰条件下的识别性能。图6绘出了不同方法平均识别率随着信噪比变化的曲线。尽管文中方法识别率随着噪声加剧而降低,但仍优于几类对比方法。文中使用的C-BEMD在复数域对SAR图像进行分析,分解得到的BIMF对于噪声干扰具有一定的鲁棒性。同时,在迭代分解的过程中考虑了噪声影响(体现在最终分解得到的残差),因此进一步增强了对噪声的处理能力。在分类过程中,通过联合稀疏表示分类结合不同特征成分的鉴别力。因此,提出方法能够在噪声干扰下的性能可以保持较高水平。

-

文中将C-BEMD应用于SAR图像特征提取及目标识别。C-BEMD是传统BEMD在复数域的扩展,能够直接用于处理复数SAR图像(包含幅度和相位信息)。文中采用C-BEMD对复数SAR图像进行特征提取,获得多层次复数BIMF,从而有效反映SAR图像的时频分布特性。分类阶段采用联合稀疏表示对提取的BIMF进行表征及分类。联合稀疏表示在独立表示各个BIMF的同时,施加不同BIMF关联性约束,可进一步提高稀疏表示精度。所提方法在MSTAR多类目标数据集上进行了验证实验。在标准操作条件下,所提方法正确识别10类目标的平均精度高达99.34%。对于扩展操作条件,文中方法的识别率有所下降,但仍优于几类现有方法。后续,随着可用SAR目标数据集的不断增多,文中将在更多样的数据集和测试场景下对方法进行进一步验证。

Application of complex bidimensional empirical mode decomposition in SAR target recognition

-

摘要: 提出基于复数二维经验模态分解(C-BEMD)的合成孔径雷达(SAR)图像目标识别。C-BEMD作为传统BEMD的复数域推广,能直接处理原始SAR图像(包含幅度和相位信息)。采用C-BEMD对原始SAR图像进行分解,获得多层次复数内蕴模函数(BIMF),反映目标时频二维特性。各层次BIMF既有独立描述能力,反映目标不同类型的特征;同时也具有内在关联性,即反映同一目标的固有属性。为此,分类算法基于联合稀疏表示设计,可利用内在关联性约束提高各层次BIMF的表征精度。利用MSTAR数据集中的多类目标SAR图像对方法进行测试验证,结果反映其在标准操作条件(SOC)和扩展操作条件(EOC)均可保持可靠的识别性能。

-

关键词:

- 合成孔径雷达 /

- 目标识别 /

- 复数二维经验模态分解 /

- 联合稀疏表示

Abstract: The complex bidimensional empirical mode decomposition (C-BEMD) was applied to target recognition of synthetic aperture radar (SAR) image. As an extension of traditional BEMD to complex domain, C-BEMD could directly process the complex SAR images (including the amplitude and phase information). C-BEMD was employed to decompose SAR images to obtain multi-layer bidimensional intrinsic mode functions (BIMF), which could reflect the time-frequency properties of images. These BIMFs had individual description capabilities, which reflected the target characteristics from different aspects. Also, they shared inner correlations, which were originated from the same target. The classification algorithm was developed based on the joint sparse representation, which used the inner correlations to improve the representation precision. The multi-class SAR images in the MSTAR dataset were used to test and validate the proposed method. The results confirm its reliable recognition performance under the standard operating condition (SOC) and extended operating conditions (EOC). -

表 1 标准操作条件描述

Table 1. Description of SOC

Class Training set (17°) Test sample set (15°) Configuration (SN) Scale of samples Configuration (SN) Scale of samples BMP2 9563 233 9563 195 BTR70 — 233 — 196 T72 132 232 132 196 812 195 S7 191 T62 — 299 — 273 BRDM2 — 298 — 274 BTR60 — 256 — 195 ZSU23/4 — 299 — 274 D7 — 299 — 274 ZIL131 — 299 — 274 2S1 — 299 — 274 表 2 型号差异描述

Table 2. Description of configruation variance

Class Training set (17°) Test sample set (15°) Configuration (SN) Scale of samples Configuration (SN) Scale of samples BMP2 9563 233 9566 196 C21 196 BTR70 — 233 — 196 T72 132 232 812 195 S7 191 表 3 俯仰角差异描述

Table 3. Description of pitch angle variance

Class Training set Test sample set Pitch angle/(°) Scale of samples Pitch angle/(°) Scale of samples 2S1 17 299 30 288 45 303 BDRM2 17 298 30 287 45 303 ZSU23/4 17 299 30 288 45 303 表 4 标准操作条件下的结果统计

Table 4. Results under SOC

Method type Average recognition rate Proposed method 99.34% NMF 98.26% Mono 98.74% BEMD 99.04% CNN 99.08% 表 5 型号差异下的结果统计

Table 5. Results under configuration variance

Method type Average recognition rate Proposed method 99.12% NMF 97.26% Mono 96.36% BEMD 98.27% CNN 98.68% -

[1] Wu Wenda, Zhang Bao, Hong Yongfeng, et al. Design of co-aperture antenna for airborne infrared and synthetic aperture radar [J]. Chinese Optics, 2020, 13(3): 595-604. (in Chinese) [2] Amoon M, Rezai-Rad G A. Automatic target recognition of synthetic aperture radar (SAR) images based on optimal selection of Zernike moment features [J]. IET Computer Vision, 2014, 8(2): 77-85. doi: 10.1049/iet-cvi.2013.0027 [3] Xie Qin, Zhang Hong. Multi-level SAR image enhancement based on regularization with application to target recognition [J]. Journal of Electronic Measurement and Instrumentation, 2018, 34(8): 21-28. (in Chinese) [4] Cui Z Y, Cao Z J, Yang J Y, et al. Target recognition in synthetic aperture radar via non-negative matrix factorization [J]. IET Radar, Sonar and Navigation, 2015, 9(9): 1376-1385. doi: 10.1049/iet-rsn.2014.0407 [5] Dong G G, Kuang G Y. Classification on the Monogenic scale space: application to target recognition in SAR image [J]. IEEE Transactions on Image Processing, 2015, 24(8): 2527-2539. doi: 10.1109/TIP.2015.2421440 [6] Li Hui. SAR target recognition based on Gaussian mixture modeling of peak features [J]. Journal of Electronic Measurement and Instrumentation, 2018, 32(8): 103-108. (in Chinese) [7] Ding Baiyuan, Wen Gongjian, Yu Liansheng, et al. Matching of attributed scattering center and its application to synthetic aperture radar Automatic Target Recognition [J]. Journal of Radar, 2017, 6(2): 157-166. (in Chinese) [8] Liu H C, Li S T. Decision fusion of sparse representation and support vector machine for SAR image target recognition [J]. Neurocomputing, 2013, 113: 97-104. doi: 10.1016/j.neucom.2013.01.033 [9] Thiagaraianm J, Ramamurthy K, Knee P P, et al. Sparse representations for automatic target classification in SAR images[C]//4th Communications, Control and Signal Processing, 2010: 1–4. [10] Chen S Z, Wang H P, Xu F, et al. Target classification using the deep convolutional networks for SAR images [J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(8): 4806-4817. doi: 10.1109/TGRS.2016.2551720 [11] Zhang Panpan, Luo Haibo, Ju Morang, et al. An improved capsule and its application in target recognition of SAR images [J]. Infrared and Laser Engineering, 2020, 49(5): 20201010. (in Chinese) doi: 10.3788/irla.26_invited-zhangpanpan [12] Xu Ying, Gu Yu, Peng Dongliang, et al. SAR ATR based on disentangled representation learning generative adversarial networks and support vector machine [J]. Optics and Precision Engineering, 2020, 28(3): 727-735. (in Chinese) doi: 10.3788/OPE.20202803.0727 [13] Yeh M H. The complex bidimensional empirical mode decomposition [J]. Signal Processing, 2012, 92: 523-541. doi: 10.1016/j.sigpro.2011.08.019 [14] Huang N E, Shen Z, Long S R, et al. The empirical mode decomposition and the Hilbert spectrum for nonlinear and nonstationary time series analysis[C]//Proceeding of the Royal Society of London, 1998: 987–995. [15] Ye Song, Li Yuanzhuang, Sun Yongfeng, et al. Extraction of spatial heterodyne spectroscopy target based on empirical mode decomposition and regression analysis [J]. Infrared and Laser Engineering, 2018, 47(12): 1223001. (in Chinese) doi: 10.3788/IRLA201847.1223001 [16] Chen Zhencheng, Wu Xianliang, Zhao Feijun. Denoising and implementation of photoplethysmography signal based on EEMD and wavelet threshold [J]. Optics and Precision Engineering, 2019, 27(6): 1327-1334. (in Chinese) [17] Chang M, You X, Cao Z. Bidimensional empirical mode decomposition for SAR image feature extraction with application to target recognition [J]. IEEE Access, 2019, 7: 135720-135731. doi: 10.1109/ACCESS.2019.2941397 [18] Tan Cuimei, Xu Tingfa, Ma Xu, et al. Graph-spectral hyperspectral video restoration based on compressive sensing [J]. Chinese Optics, 2018, 11(6): 949-957. (in Chinese) doi: 10.3788/co.20181106.0949 -

下载:

下载: